Author: jeff meridian

TL;DR – Hören Sie auf, von “Token” besessen zu sein. Protokollieren Sie stattdessen die Token-Nutzung, speichern Sie wiederverwendbare Eingabeaufforderungen im

Cache, beginnen Sie die Token-Budgets und halten Sie ein lustiges lokales Modell auf dem Laufen.

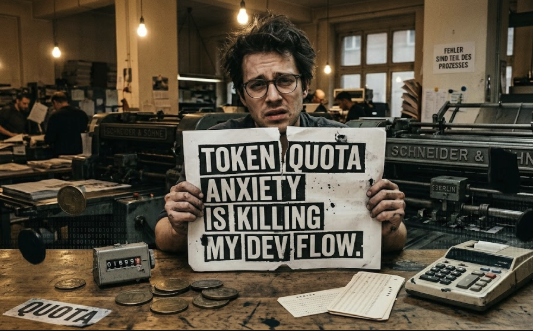

Heute Morgen bin ich im Morgengrauen aufgewacht und hatte mich schon gefreut, Fehler in der App aus zu merzen und neue Features auszuliefern, nur um dann auf einem Pop‑up Fenster zu starren, auf dem steht, dass mein Kontingent erst um 21:30 Uhr aktualisiert wird. So sieht das aus man, Pop‑ups, unerbittliche Pop‑ups, die mir bitter ins Gesicht schlagen und schreien “Du hast deine Quote überschritten! Spiel vorbei, aus die Maus.

Das Downgrade beginnt immer langsam, wenn sie die ersten Premium-Modelle abklemmen, sodass ich auf ältere Modelle beschränkt bleibe. Ich kratze alles an Token, was ich kann, aus diesen Model Relikten, before ich abstürze auf Claude Sonnet, Opus und schlußendlich zum düsteren, unter dem‑ Radar GPT‑OSS 120B, bis meine Codierungsmaschine völlig zum Stillstand kommt.

Der gesamte Branchenzirkus schreibt seine Token-Quotenpolitik mit unsichtbarer Tinte. Sie meinem Code editor haben sie jetzt einen “Extra-Credits”-Button eingebaut, einen mysteriösen Knopf, der mehr Token verspricht. Ja, ich nehme die KI schon hart ran und nutze jeden Token an Informationen die ich raus quetschen kann, aber ich verstehe einfach nicht, was ein Ultra-Token-Upgrade wirklich bedeutet.

Eine neue Art von Angst: symbolische Reichweitenangst, wie die Elektro-‑Autoversion der Reichweitenangst, die an mir nagt, während ich Prompts an die KI zusammennähe. Die naechste Code-Halluzination raubt mir Token und das die KI weigert sich, den Schlamassel zu beheben.

Es ist ein Spielzeug, mit dem man spielen kann, bis die Batterien leer sind, dann steht man im Dunkeln.

Sich auf Modelle zu verlassen, die man nicht auf dem eigenen Computer laufen lassen kann, ist wie eine Mitfahrgelegenheit, ohne Lenkrad. Die Meister der KI, halten Sie das Lenkrad auf einer Autobahn Richtung Hölle.

Das Universum grinst. Es ist ein schlechter Deal, mein Freund, eine Geiselnahme, aber ist es das wirklich?

Ich sage, es ist Zeit, meinen faulen Arsch hochzukriegen und einen Sprint aus Codeanalysen und Refactoring zu machen.

Die Hype‑Maschine frisst deine “Tokens” wie Pac‑Man‑Pillen. Ich habe aufgehört, dem Hype hinterherzujagen, und fange an, die verdammte Pipe zu reparieren.

Ich habe meinen gesamten Stack in ein forensisches Labor verwandelt. Ich habe die API des Modells auseinandergerissen, einen schlanken Logger dran geklebt und es gezwungen, prompt_tokens, completion_tokens und total_tokens auszuspucken. Diese drei Zahlen schlängeln sich jetzt in eine Datenbank, wie ein Blut‑Druck‑Messgerät, das an den Herzschlag meiner KI geklebt ist.

Ich gehe auf Jagd nach jedem statischen Sub‑Prompt, der immer wieder – System‑Anweisungen, Schema‑Definitionen sendet, das öde Boiler‑Plate, das ich wie eine kaputte Kassette immer wieder sende. Diese Bausteine werfe ich in einen Cache, friere ihre Token ein und, anstatt das Modell zu überfluten. Das ist wie ein Cowboy, der Ersatz‑Munition in seinem Sattel verstaut.

Ich setze eine harte Obergrenze: 2 k Token, keine Ausnahmen. Alles, was höher klettern will, wird gnadenlos abgeschnitten oder in einen einzigen, brutalen Satz komprimiert, bevor es das Modell überhaupt erreicht. Das ist die “Fett‑weg‑Diät” für meinen Prompt‑Magen.

Wenn der Strom von billigen, hochfrequenten Transformationen zu einem reißenden Strom wird, ziehe ich die Cloud‑Sauger aus dem Bild und drehe ein 7 B quantisiertes Biest in meiner Garage auf. Dieses On‑Premise‑LLM hält den kritischen Pfad lokal, günstig und fest in meiner Hand.

Ich stelle mir die Fähigkeit‑Oberfläche des Modells vor wie eine raue Klippe in einem psychedelischen Horror‑Film. Das glatte, verführerische “High‑Token”‑Plateau glänzt wie eine Fata Morgana unendlicher Macht. Einen Schritt zuweit und ich stuerze in ein Token-Meer aus Rechen‑ und Latenzzeit. Mein Ziel? Den stabilen Pfad finden – die schmale Kante, an der ein paar Token das maximale Ergebnis freisetzen. Ich schneide einen wiederholbaren Grenze entlang dieser gezackten Kueste.

Nur mein von Koffein angetriebener Verstand kann das Gold vom Glitzer trennen. Ich entscheide, welche Daten wirklich wichtig sind und welches “nice‑to‑have”‑Gerümpel ist.

Prompt‑Relevanz, Token‑Budget‑Richtlinien und der Moment, in dem ich den Schalter zu einem lokalen Modell umlege, sind Entscheidungen, die keine algorithmische Marionette treffen kann, ohne in einem Tümpel aus Fehlermeldungen zu versauern.

Ich lege einen Ein‑Zeilen‑Wrapper um meinen LLM‑Client, der prompt_tokens, completion_tokens und total_tokens in eine CSV (oder direkt in meine Datenbank) protokolliert. Das ist mein Rauchmelder für Token‑Verschwendung.

Ich baue einen Trigger, der schreit, sobald ein Aufruf die Token‑Grenze überschreitet. Der Alarm heult wie eine Sirene auf einem Schrottplatz.

Wenn der Alarm heult, stürze ich mich drauf, finde den Schuldigen und cache, kürze oder verlagere ihn auf meinen lokalen Rechner.

Dieser einzelne Datenpunkt zeigt mir exakt, wo das System blutet, und gibt mir den Hebel, um den Fluss in der Daten-Pipline zu kontrollieren.

Comments & Ratings

#

Loading comments...